L’influence de l’information visuelle sur la perception de la parole est bien connue. Par exemple, lorsque nous sommes dans un environnement bruyant, la lecture labiale facilite la compréhension de la parole.

Dans ce contexte, notre cerveau combine les informations auditives et visuelles liées à la parole, ce qui correspond au phénomène d’intégration audiovisuelle. Un exemple concret de ce phénomène est l’effet McGurk.

La directrice de notre laboratoire, Pascale Tremblay, ainsi que ses collaborateurs Français Anahita Basirat, Serge Pinto et Marc Sato, ont mené un projet de recherche dans lequel ils ont étudié ce phénomène. Plus spécifiquement, ils ont étudié l’impact de différents types d’indices visuels sur la capacité à percevoir la parole, et examiné si le processus d’intégration audiovisuelle changeait avec l’âge.

Bonne nouvelle pour l’équipe : l’article scientifique présentant les résultats de cette étude vient tout juste d’être accepté pour publication dans le journal Neuropsychologia ! Nous saisissons cette occasion pour vous présenter un résumé de l’étude et de ses résultats.

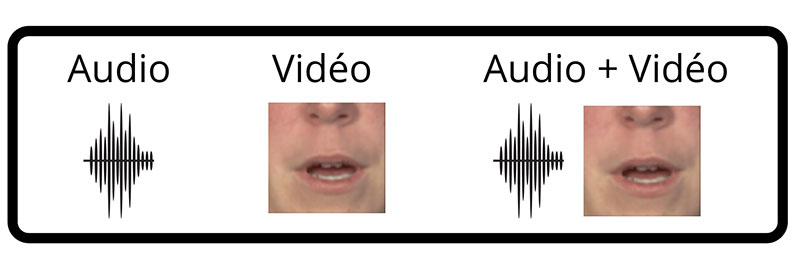

Dans l’étude, 34 personnes (17 jeunes adultes âgés entre 20 et 42 ans, ainsi que 17 adultes plus âgés ayant entre 60 et 73 ans), ont réalisé un test durant lequel des syllabes (pa, ta ou ka) leur étaient présentées les unes après les autres. Les syllabes étaient présentées de trois façons : auditive seulement, visuelle seulement (vidéo d’une personne prononçant la syllabe, mais sans son), ou auditive et visuelle (son et vidéo combinés), tel qu’illustré à la figure 1.

Figure 1. Illustration des trois modes de présentation des syllabes durant le test de perception de la parole.

Les participants et participantes devaient indiquer laquelle des trois syllabes était présentée en appuyant sur un bouton. Des indices étaient parfois fournis aux participants et participantes. Par exemple, la syllabe écrite pouvait apparaître à l’écran pendant un court laps de temps, ce qui constituait un indice visuel. La performance des participants et participantes au test était mesurée. Les réponses neurophysiologiques liées à la perception de la parole (et plus spécifiquement le complexe P1-N1-P2) étaient également mesurées chez les participants et participantes à l’aide de l’électroencéphalographie, soit au moyen d’électrodes placées sur le cuir chevelu.

Voici un résumé des principaux résultats observés :

- La capacité des personnes âgées à lire sur les lèvres est réduite de manière significative par rapport aux jeunes adultes.

- Le groupe de jeunes adultes et le groupe de personnes plus âgées ont tous deux bénéficié de l’information visuelle (vidéo avec la prononciation de la syllabe) pour percevoir la parole, mais le bénéfice conféré par l’information visuelle était plus grand chez les jeunes adultes.

- Les indices visuels (par exemple, apparition de la syllabe écrite) ont facilité la perception de la parole de manière similaire chez les adultes jeunes et âgés. Ainsi, la capacité à intégrer les informations auditives et visuelles semble être préservée chez les personnes plus âgées, bien que leur aptitude à lire sur les lèvres soit réduite.

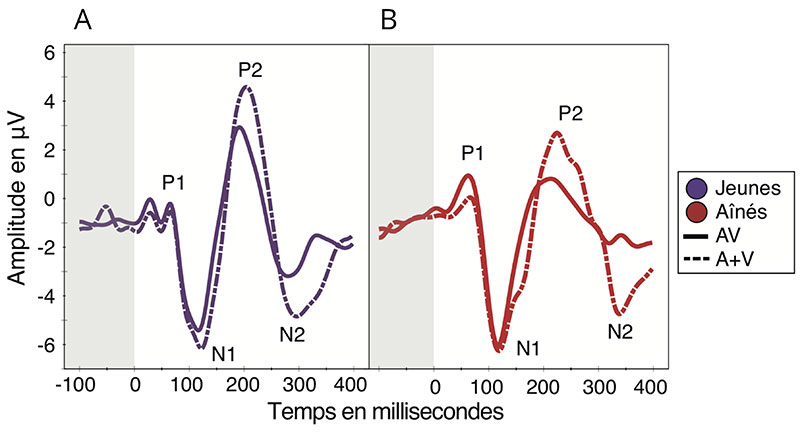

- Les réponses neurophysiologiques étaient différentes entre les jeunes adultes et les adultes plus âgés (p. ex. les « sommets » des potentiels évoqués P2 et N2, illustrés sur la figure 2, survenaient plus tardivement chez le groupe de personnes plus âgées en comparaison aux jeunes adultes), ce qui indique que l’âge influence l’activité cérébrale liée à la perception de la parole. Les processus les plus affectés étaient les processus d’intégration, et non les processus auditifs.

- Les réponses neurophysiologiques, et plus spécifiquement l’amplitude du potentiel évoqué P2, étaient associées à la performance au test de parole chez les personnes aînées.

Figure 2. Illustration des réponses neurophysiologiques mesurées avec l’EEG chez les jeunes adultes (A) et chez les adultes plus âgés (B) lors du test de perception de la parole.

En somme, l’âge influence la perception de la parole et l’intégration audiovisuelle. Les résultats fournissent des pistes intéressantes pour le développement d’interventions visant à améliorer la capacité à percevoir la parole chez des personnes âgées, lesquelles pourraient par exemple cibler l’aptitude à traiter l’information visuelle (p. ex. lire sur les lèvres) et à intégrer cette information à l’information auditive pour compenser par exemple la perte auditive.

Référence de l’article complet : Tremblay, P., Basirat, A., Pinto, S. & Sato, M. (2021). Visual prediction cues can facilitate behavioural and neural speech processing in young and older adults. Accepté pour publication dans Neuropsychologia.

Lien vers l’article : Visual prediction cues can facilitate behavioural and neural speech processing in young and older adults.